Существует множество способов использовать звук для улучшения приложения. Звук может дополнять другие элементы интерфейса, чтобы пользователи легко распознавали разные события. Звук может стать эффективным элементом интерфейса для пользователей с нарушениями зрения. Вы можете использовать звук для создания атмосферы, в которую погружается пользователь. Например, можно воспроизводить причудливую мелодию в фоновом режиме в игре-головоломке или использовать зловещие звуковые эффекты для игр в стиле «хоррор» и игр на выживание.

Примеры

Если у вас установлено приложение коллекции WinUI 2 , щелкните здесь, чтобы открыть приложение и увидеть Sound в действии.

- Получение приложения коллекции WinUI 2 (Microsoft Store)

- Получить исходный код (GitHub)

Глобальный API звука

Платформа UWP предоставляет легкодоступную звуковую систему, которая позволяет отвлечься и в полной мере насладиться звуковыми возможностями приложения.

ElementSoundPlayer — это интегрированная звуковая система в XAML. Если она включена, все стандартные элементы управления воспроизводят звуки автоматически.

Слишком громкий звук телевизора не совсем устраивает спящую Басю)

ElementSoundPlayer.State = ElementSoundPlayerState.On;

ElementSoundPlayer имеет три различных состояния: OnOff и Auto.

Если задано значение Off, звук воспроизводиться не будет, независимо от того, где запущено приложение. Если задано значение On, звуки для вашего приложения будут воспроизводиться на всех платформах.

Включение ElementSoundPlayer автоматически приводит к активации пространственного (трехмерного) звука. Чтобы отключить трехмерный звук (но сохранить звук включенным), отключите SpatialAudioMode объекта ElementSoundPlayer:

ElementSoundPlayer.SpatialAudioMode = ElementSpatialAudioMode.Off

Свойство SpatialAudioMode может принимать следующие значения:

- Auto: пространственный звук будет включен после включения звука.

- Off: пространственный звук всегда выключен, даже если звук включен.

- On: пространственный звук всегда воспроизводится.

См. подробнее о пространственном звуке и о том, как XAML его обрабатывает, в разделе AudioGraph — пространственный звук.

Звук для телевизора и Xbox

Звук имеет важное значение для взаимодействия с 3 метров, поэтому по умолчанию для ElementSoundPlayer установлено значение Auto. Это означает, что звук будет воспроизводиться, только когда приложение запущено на Xbox. Дополнительные сведения о проектировании для Xbox и телевизора см. в статье Проектирование для Xbox и телевизора.

Переопределение громкости звука

Громкость всех звуков в приложении можно уменьшить с помощью регулятора громкости. Тем не менее, звуки в приложении не могут воспроизводиться громче уровня, настроенного в системе.

Чтобы настроить уровень громкости приложения, вызовите:

ElementSoundPlayer.Volume = 0.5;

Максимальная громкость составляет 1,0 (относительно громкости в системе), а минимальная — 0,0 (по сути это отсутствие звука).

API простыми словами. Что такое API? | 2022

Режим для элемента управления

Если нет необходимости воспроизводить звук элемента управления по умолчанию, его можно отключить. Это можно сделать с помощью ElementSoundMode в элементе управления.

ElementSoundMode имеет два состояния: Off и Default. По умолчанию установлено значение Default. Если задано значение Off, будут отключены все звуки, воспроизводимые элементом управления, за исключением фокуса.

ButtonName.ElementSoundState = ElementSoundMode.Off;

Выбор правильного звука

При создании пользовательского элемента управления или изменении звука существующего элемента управления важно учитывать принципы использования звуков, предоставляемых системой.

Каждый звук ассоциируется с определенным взаимодействием с пользователем, и, несмотря на то что для каждого типа взаимодействия можно настроить любой звук, существуют определенные принципы использования звуков, которые следует соблюдать, чтобы обеспечить согласованное взаимодействие во всех приложениях UWP.

Вызов элемента

Наиболее распространенным звуком, воспроизводимым элементом управления, в нашей системе является звук Invoke (Вызов). Этот звук воспроизводится, когда пользователь вызывает элемент управления с помощью касания, щелчка, нажатия клавиши ВВОД либо ПРОБЕЛ или же нажатия кнопки «А» на игровом контроллере.

Обычно этот звук воспроизводится, только когда пользователь явно нацеливается на простой элемент управления или часть элемента управления посредством устройства ввода.

Чтобы воспроизводить звук при всех событиях элемента управления, вызовите метод Play из ElementSoundPlayer и передайте его в ElementSound.Invoke:

ElementSoundPlayer.Play(ElementSoundKind.Invoke);

Отображение

И наоборот, когда окно содержимого наложения закрывается или исчезает, должен вызываться звук Hide:

ElementSoundPlayer.Play(ElementSoundKind.Hide);

Навигация в пределах страницы

Навигация между панелями или представлениями в пределах страницы приложения (см. раздел NavigationView) — это обычно двунаправленное движение. Это означает, что можно перейти к следующему или предыдущему представлению либо панели, не покидая текущую страницу приложения.

Эта концепция навигации представлена звуками MovePrevious и MoveNext.

При переходе к представлению или панели, которая считается следующим элементом в списке, вызовите команду:

ElementSoundPlayer.Play(ElementSoundKind.MoveNext);

А при переходе к предыдущему представлению или панели, которая считается предыдущим элементом, вызовите команду:

ElementSoundPlayer.Play(ElementSoundKind.MovePrevious);

Обратная навигация

При переходе с текущей страницы на предыдущую страницу в приложении должен вызываться звук GoBack:

ElementSoundPlayer.Play(ElementSoundKind.GoBack);

Фокусировка на элементе

Звук Focus является единственным неявным звуком в нашей системе. Это означает, что пользователь слышит этот звук, даже когда не выполняет явных взаимодействий.

Фокусировка происходит, когда пользователь перемещается по приложению с помощью игрового контроллера, клавиатуры, пульта или устройства Kinect. Обычно звук Focusне воспроизводится при событиях PointerEntered или событиях наведения указателя мыши.

Чтобы настроить для элемента управления воспроизведение звука Focus при фокусировке на нем, вызовите команду:

ElementSoundPlayer.Play(ElementSoundKind.Focus);

Циклический перебор звуков фокусировки

Для вызова ElementSound.Focus предоставляется дополнительная возможность — звуковая система по умолчанию воспроизводит по очереди 4 разных звука для каждого действия навигации. Это означает, что звуки фокуса, воспроизводимые один за другим, не повторяются.

Цель этой циклической функции заключается в обеспечении разнообразия и незаметности звуков фокуса, так как они воспроизводятся наиболее часто и должны быть самыми ненавязчивыми.

Получение примера кода

- Пример коллекции WinUI 2 . Просмотр всех элементов управления XAML в интерактивном формате.

Похожие статьи

- Проектирование для Xbox и ТВ

- Документация по классу ElementSoundPlayer

Источник: learn.microsoft.com

Концепции, лежащие в основе Web Audio API

В этой статье объясняются некоторые концепции из теории музыки, на основе которых работает Web Audio API (WAA). Зная эти концепции, вы сможете принимать взвешенные решения при проектировании аудио в приложении. Статья не сделает вас опытным инженером по звуку, но поможет понять, почему WAA работает так, как работает.

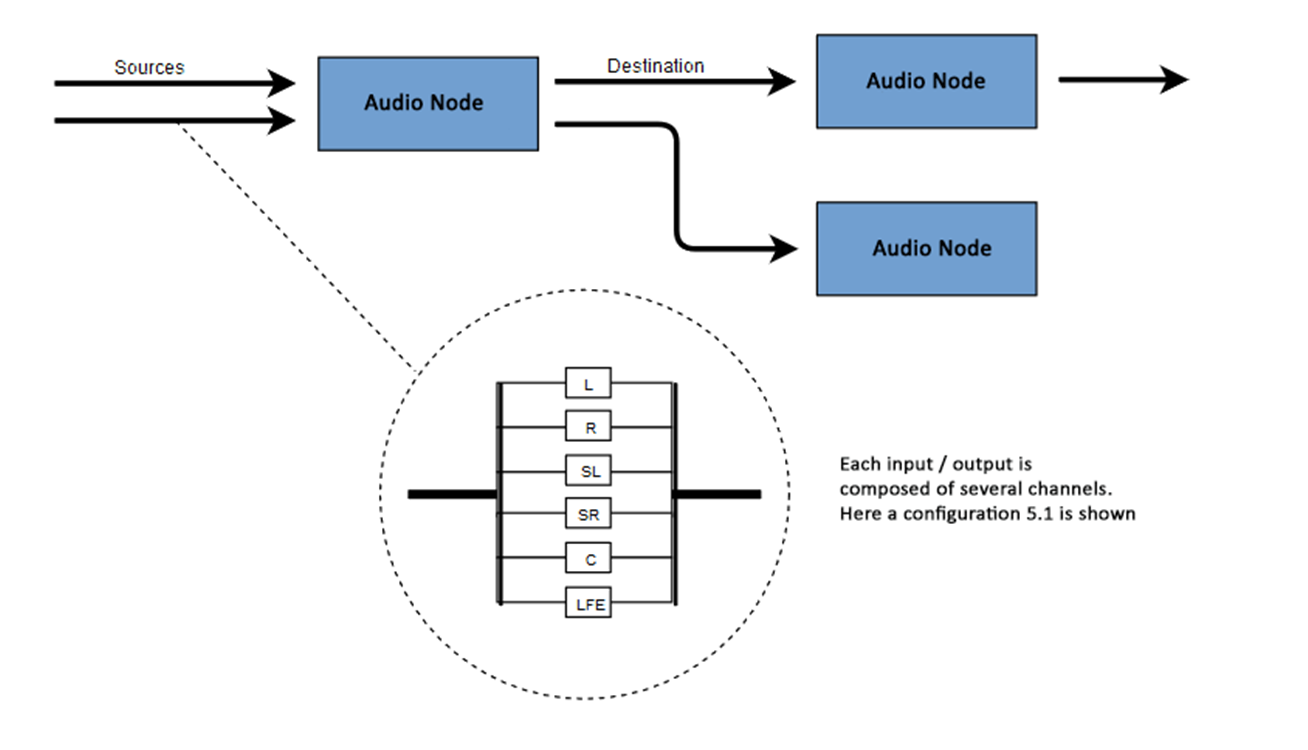

Аудио схема

Суть WAA заключается в выполнении некоторых операций со звуком внутри аудио контекста (audio context). Этот API был специально разработан для модульной маршрутизации (modular routing). Основные операции со звуком представляют собой узлы (audio nodes), связанные между собой и формирующие схему маршрутизации (audio routing graph). Несколько источников — с разными типами каналов — обрабатываются внутри единого контекста. Такая модульная схема обеспечивает необходимую гибкость для создания сложных функций с динамическими эффектами.

Аудио узлы связаны между собой через входы и выходы, формируют цепь, которая начинается от одного или нескольких источников, проходит через один или несколько узлов, и заканчивается в пункте назначения (destination). В принципе, можно обойтись и без пункта назначения, например, если мы хотим просто визуализировать некоторые аудио данные. Типичный рабочий процесс для веб аудио выглядит примерно так:

- Создаем аудио контекст

- Внутри контекста создаем источники — такие как , осциллятор (генератора звука) или поток

- Создаем узлы эффектов, такие как реверберация, биквадратный фильтр, паннер или компрессор

- Выбираем пункт назначения для аудио, такой как колонки компьютера пользователя

- Устанавливаем соединение между источниками через эффекты к пункту назначения

Обозначение канала

Количество доступных аудио каналов часто обозначается в числовом формате, например, 2.0 или 5.1. Это называется обозначением канала. Первая цифра означает полный диапазон частот, которые включает сигнал. Вторая цифра означает количество каналов, зарезервированных для выходов низкочастотного эффекта — сабвуферов.

Каждый вход или выход состоит из одного или более каналов, построенных по определенной аудио схеме. Существуют различные дискретные структуры каналов, такие как моно, стерео, квадро, 5.1 и т.д.

Аудио источники могут быть получены разными способами. Звук может быть:

- Сгенерирован JavaScript-кодом посредством аудио узла (такого как осциллятор)

- Создан из необработанных данных с помощью ИКМ (импульсно-кодовой модуляции)

- Получен из медиа элементов HTML (таких как или )

- Получен из медиа потока WebRTC (такого как вебкамера или микрофон)

Аудио данные: что находится в семпле

Семплирование означает преобразование непрерывного сигнала в дискретный (разделенный) (аналогового сигнала в цифровой). Другими словами, непрерывная звуковая волна, такая как живой концерт, преобразуется в последовательность семплов, что позволяет компьютеру обрабатывать аудио отдельными блоками.

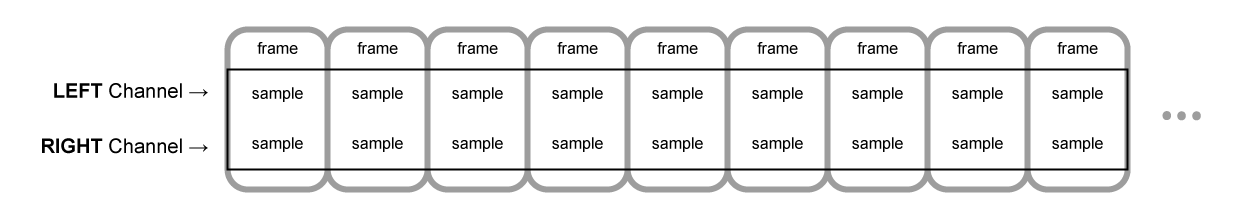

Аудио буфер: кадры, семплы и каналы

AudioBuffer в качестве параметров принимает количество каналов (1 для моно, 2 для стерео и т.д.), длину — количество кадров семпла внутри буфера, и частоту дискретизации — количество кадров в секунду.

Семпл — это простое 32-битное значение с плавающей точкой (float32), представляющее собой значение аудио потока в конкретный момент времени и в конкретном канале (левый или правый и др.). Кадр или кадр семпла — это набор значений всех каналов, воспроизводимых в определенный момент времени: все семплы всех каналов, воспроизводимые в одно и тоже время (два для стерео, шесть для 5.1 и т.д.).

Частота дискретизации — это количество семплов (или кадров, поскольку все семплы кадра проигрываются в одно время), воспроизводимые за одну секунду, измеряется в герцах (Гц). Чем выше частота, тем лучше качество звука.

Давайте посмотрим на моно и стерео буферы, каждый длиной в одну секунду, воспроизводимые с частотой 44100 Гц:

- Моно буфер будет иметь 44100 семплов и 44100 кадров. Значением свойства «length» будет 44100

- Стерео буфер будет иметь 88200 семплов, но также 44100 кадров. Значением свойства «length» будет 44100 — длина равняется количеству кадров

Когда начинается воспроизведение буфера, мы сначала слышим крайний левый кадр семпла, затем ближайший к нему правый и т.д. В случае стерео, мы слышим оба канала одновременно. Кадры семпла не зависят от количества каналов и предоставляют возможность для очень точной обработки аудио.

Заметка: чтобы получить время в секундах из количества кадров необходимо разделить количество кадров на частоту дискретизации. Чтобы получить количество кадров из количества семплов, делим последние на количество каналов.

let context = new AudioContext() let buffer = context.createBuffer(2, 22050, 44100)

Заметка: в цифровом аудио 44100 Гц или 44.1 кГц — это стандартная частота семплирования. Но почему 44.1 кГц?

Во-первых, потому что диапазон слышимых частот (частот, различимых человеческим ухом) варьируется от 20 до 20000 Гц. Согласно теореме Котельникова частота дискретизации должна более чем в два раза превышать наибольшую частоту в спектре сигнала. Поэтому частота семплирования должна быть больше 40 кГц.

Во-вторых, сигналы должны быть отфильтрованы с помощью фильтра нижних частот перед семплированием, в противном случае будет иметь место наложение спектральных «хвостов» (подмена частот, маскировка частот, алиасинг) и форма восстановленного сигнала будет искажена. В идеале, фильтр нижних частот должен пропускать частоты ниже 20 кГц (без ослабления) и отбрасывать частоты выше 20 кГЦ. На практике требуется некоторая переходная полоса (между полосой пропускания и полосой подавления), где частоты частично ослабляются. Более легким и экономичным способом это сделать является применение противоподменного фильтра. Для частоты дискретизации равной 44.1 кГц переходная полоса составляет 2.05 кГц.

В приведенном примере мы получим стерео буфер с двумя каналами, воспроизводимый в аудио контексте с частотой 44100 Гц (стандарт), длиной 0.5 секунды (22050 кадров / 44100 Гц = 0.5 с).

let context = new AudioContext() let buffer = context.createBuffer(1, 22050, 22050)

В данном случае мы получим моно буфер с одним каналом, воспроизводимый в аудио контексте с частотой 44100 Гц, произойдет его передискретизация до 44100 Гц (и увеличение кадров до 44100), длиной 1 секунда (44100 кадров / 44100 Гц = 1 с).

Заметка: аудио передискретизация («ресемплирование») очень похоже на изменение размеров («ресайзинг») изображений. Допустим, у нас есть изображение размером 16х16, однако мы хотим заполнить этим изображением область размером 32х32. Мы делаем ресайзинг. Результат будет менее качественным (может быть размытым или рваным в зависимости от алгоритма увеличения), но это работает. Ресемплированное аудио — это тоже самое: мы сохраняем пространство, но на практике едва ли получится добиться высокого качества звучания.

Планарные и чередующиеся буферы

В WAA используется планарный формат буфера. Левый и правый каналы взаимодействуют следующим образом:

LLLLLLLLLLLLLLLLRRRRRRRRRRRRRRRR (для буфера, состоящего из 16 кадров)

В данном случае каждый канал работает независимо от других.

Альтернативой является использование чередующегося формата:

LRLRLRLRLRLRLRLRLRLRLRLRLRLRLRLR (для буфера, состоящего из 16 кадров)

Такой формат часто используется для декодирования MP3.

В WAA используется только планарный формат, поскольку он лучше подходит для обработки звука. Планарный формат преобразуется в чередующийся, когда данные отправляются на звуковую карту для воспроизведения. При декодировании MP3 происходит обратное преобразование.

Аудио каналы

Разные буферы содержат разное количество каналов: от простых моно (один канал) и стерео (левый и правый каналы) до более сложных наборов, таких как квадро и 5.1 с разным количеством семплов в каждом канале, что обеспечивает более насыщенное (богатое) звучание. Каналы обычно представлены аббревиатурами:

| Моно | 0: М: моно |

| Стерео | 0: L: левый 1: R: правый |

| Квадро | 0: L: левый 1: R: правый 3: SL: дополнительный левый (левый канал, создающий окружение; surround left) 4: SR: дополнительный правый (surround right) |

| 5.1 | 0: L: левый 1: R: правый 2: C: центральный 3: LFE: сабвуфер 4: SL: дополнительный левый 5: SR: дополнительный правый |

Смешивание вверх (up-mixing) и вниз (down-mixing)

Когда количество каналов на входе и выходе не совпадает, применяют смешивание вверх или вниз. Смешивание контролируется свойством AudioNode.channelInterpretation:

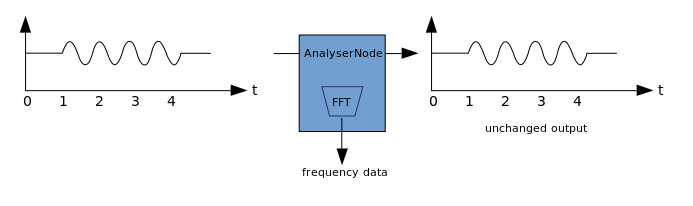

Визуализация

Визуализация зиждется на получении выходных аудио данных, таких как данные об амплитуде или частоте, и их последующей обработке с помощью каких-либо графических технологий. В WAA имеется AnalyzerNode (анализатор), который не искажает проходящий через него сигнал. При этом он способен извлекать данные из аудио и передавать их дальше, например, в .

Для извлечения данных могут быть использованы следующие методы:

- AnalyzerNode.getFloatByteFrequencyData() — копирует текущие данные о частоте в массив Float32Array

- AnalyzerNode.getByteFrequencyData() — копирует текущие данные о частоте в массив Uint8Array (байтовый массив без знака)

- AnalyserNode.getFloatTimeDomainData() — копирует текущие данные о форме волны или шаге дискретизации в массив Float32Array

- AnalyserNode.getByteTimeDomainData() — копирует текущие данные о форме волны или шаге дискретизации в массив Uint8Array

Спатиализация

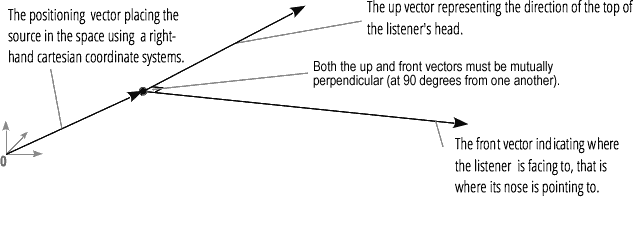

Аудио спатиализация (обрабатываемая PannerNode и AudioListener) позволяет моделировать позицию и направление сигнала в конкретной точке пространства, а также позицию слушателя.

Позиция паннера описывается с помощью правосторонних картезианских координат; для движения используется вектор скорости, необходимый для создания эффекта Доплера, для направления используется конус направленности. Этот конус может быть очень большим в случае разнонаправленных источников звука.

Позиция слушателя описывается так: движение — с использованием вектора скорости, направление, где находится голова слушателя — с использованием двух векторов направленности, спереди и сверху. Привязка осуществляется к верхней части головы и носу слушателя под прямым углом.

Соединение и разветвление

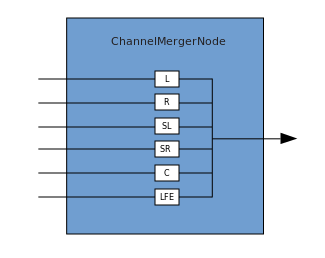

Соединение описывает процесс, в ходе которого ChannelMergerNode принимает несколько входных моно источников и соединяет их в один многоканальный сигнал на выходе.

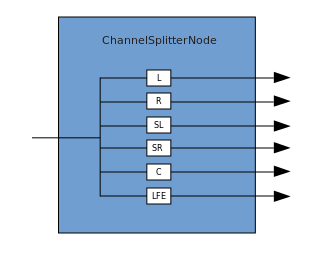

Разветвление представляет собой обратный процесс (осуществляется посредством ChannelSplitterNode).

Пример работы с WAA можно посмотреть здесь. Исходный код примера находится здесь. Вот статья про то, как все это работает.

Источник: habr.com

3D-звук: мифы или реальность

Здравствуйте, уважаемые читатели сайта Uspei.com. Глядя на огромный прорыв в 3D-графике, спецэффектах в фильмах, росте разрешений и кадровых частот у меня часто возникает вопрос: а что со звуком?

Разумеется, технологии не стоят на месте, окружающий звук в кинотеатрах все так же громко окружает, все больше девайсов клеят плашку Hi-Res на коробку, сабвуферами в телевизорах и ноутбуках уже никого не удивить, да и у ни кого не будет сомнений, что в новой части Battlefield грохот взрывов и выстрелов будет впечатлять.

Немного истории многоканального звука

Многоканальный звук у большинства людей ассоциируется с кинотеатрами и домашними аудиосистемами, и это неудивительно: киноиндустрия осваивала это с 40-х годов прошлого века, а с приходом технологии Dolby Surround киноманы могли насладиться многоканальным звуком на видеокассетах в далеких 80-х.

Магия кодирования и декодирования компании Dolby позволяла записывать и воспроизводить стерео сигнал сначала расширяя его до 3 каналов, потом до 4 и 6 с улучшенной Pro Logic, а в 1992 году 6 каналов стали честными с приходом Dolby Digital.

Началом конкуренции между Dolby и DTS был конец 90-х, когда киноманы начали переходить с видеокассет на Laserdisc, а в последствии на DVD и Blu-ray.

Спустя почти 20 лет компании Dolby и DTS серьезно укоренились не только в кинотеатрах, где им пытается противостоять формат Auro-3D, но и в многоканальном аудио на ПК, в игровых консолях, телевизорах и даже смартфонах, предлагая одним инновационные разработки в психоакустике, а другим эквалайзеры-пустышки.

Dolby Access и DTS Sound Unbound и что они предлагают

В битве за игры и сервисы пока что побеждает компания Dolby, которая может похвастаться поддержкой не только нескольких крупных игровых проектов, но и стриминговых сервисов Netflix, Disney+ и других.

Покупать и заморачиваться с установкой и калибровкой дорогостоящего набора акустики необязательно: многолетний кинокаталог с звуковыми дорожками в формате Dolby Digital работает с Dolby Atmos для наушников и встроенным в Windows 10 видеоплеером из коробки.

Так что же нам предлагают эти две компании и нужно ли покупать Dolby Access или DTS Sound Unbound?

Копаясь на страницах этих товаров в магазине Microsoft, понимаешь, что с маркетингом у аудио-компаний как всегда все плохо: пользователям по-прежнему предлагают купить кота в мешке, обещая сногсшибательную детализацию и реализм в играх и кино, при этом забывая указать, что софт вообще-то не бесплатный и что там с пробным периодом.

Демо-ролики, которые должны ошеломить, звучат невнятно, а тестовые видеофайлы для проверки работы всех каналов, включая потолочные, найти непросто. Неудивительно, что многих пользователей такой подход только укрепил во мнении, что эти программы и все, что связано с 3D-звуком — надувательство маркетологов.

И это прискорбно, поскольку технологии, которые лежат в основе пространственного звука, существуют давно и отлично работают, но каждый раз спотыкаются о неумелых маркетологов и тонкости настройки.

Aureal та Creative

Помянем компанию Aureal, технологиями которой можно было насладиться в первой Half-Life, Unreal, Quake III, и поглотившую ее компанию Creative с технологией EAX, которая ласкала уши в нескольких сотнях игр. Нет, компания не мертва, но и живой ее можно назвать с натяжкой.

С выходом Windows Vista Microsoft вытерла ноги о компанию Creative с ее EAX, убрав возможность аппаратного ускорения API DirectSound. С тех пор задачи 3D-позиционирования, отражений и реверберации звука легли на игровой движок и центральный процессор.

Технология HRTF и виртуальный объемный звук

Итак, давайте попробуем разобраться, что сейчас предлагают Dolby Labs, DTS, а также другие компании в сфере виртуального объемного звучания в наушниках. 3D-звук, виртуальный surround, пространственное аудио — это красивые названия для технологии HRTF.

Head-related transfer function переводится как передаточная функция головы, согласитесь, такой бренд было бы трудно рекламировать. Бинауральное аудио — более знакомое словосочетание, и я бы тут добавил к нему приставку виртуальное.

На мой взгляд, это лучше всего отражает суть технологии, которая преображает стерео или многоканальный аудио сигнал согласно усредненной формуле акустических свойств головы, верхней части туловища и внешнего уха, которые влияют на определение нами направления звука.

Звучит сложно, но суть простая: если нам достаточно двух ушей, чтобы определить местоположение звука в пространстве, то значит должно хватить обычных наушников, чтобы воссоздать тот же эффект. Но лучше один раз услышать, чем сто раз рассказывать, поэтому я оставил лучшие, на мой взгляд, примеры бинаурального аудио в конце обзора.

Первое знакомство с бинауральным звуком оставляет неизгладимое впечатление. Как это записывают и почему игры и фильмы не используют бинауральное аудио?

Записать бинауральный звук не так уж и сложно: необходима звуковая карта, компьютер и голова-манекен, в идеале Neumann KU-100 за 10 тысяч долларов, в которую уже вмонтированы в уши два высокочувствительных микрофона.

Можно и сэкономить, взяв комплект MiniDSP EARS, но это не решает главной проблемы: большинство людей потребляет контент через динамики ноутбуков, телефонов и акустических систем, которым нужен совершенно по-другому записанный и сведенный позже звук.

Бинауральный можно записать только сразу и целиком, что никак не подойдет для кино и игропрома, где отдельные звуковые эффекты и дорожки собираются воедино звуковым движком или звукорежиссером на этапе пост-продакшена.

Единственным возможным компромиссом остается традиционное сведение звука для стерео и многоканальных систем, а хозяевам наушников перепадает программная имитация бинаурального звука.

Эта работает примерно так: игра или кино отправляет многоканальный 7.1 звук звуковому интерфейсу WASAPI (Windows Audio Session API), далее передается объекту аудио обработки (от Dolby, DTS или других разработчиков) и обрабатывается согласно 8 каналов направления звука (спереди, сзади, сбоку).

Dolby Atmos работает иначе и полагается не на количество каналов, а на объекты звука в трехмерном пространстве, количество которых может достигать 128. Готовый стерео или многоканальный сигнал передается наушникам или акустической системе.

Вот вам неофициальный список игр с поддержкой 3D-аудио позиционирования. Из 93 игр большая часть современных игр на ПК и XBOX Series S и X использует платный Dolby Atmos и бесплатный Windows Sonic.

Steam Audio и современная реализация 3D-аудио в играх

С выходом в свет библиотек Steam Audio и их интеграции в движки Unity и Unreal HRTF появился в таких популярных проектах, как CS:GO, Escape from Tarkov, Valorant и PUBG, а движок Cryengine может похвалиться собственным HRTF-плагином CrySpatial в игре Hunt: Showdown.

Быстрое и точное определение местоположения противника по звуку — залог победы в этих играх, поэтому неудивительно, что разработчики придают этому большое значение.

Официальный список игр с поддержкой звукового движка Tempest для Playstation 5 насчитывает всего лишь 11 проектов, большинство из которых эксклюзивы Sony. И если оставить включенной функцию 3D-звука в настройках консоли, то игры без ее поддержки (а это весь каталог игр прошлого поколения) будут звучать откровенно плохо.

3D-звук в играх без его поддержки, аппаратные решения

Но можно ли превратить звук в не самой свежей и высокобюджетной игре в пространственный? Да, но реализовать на практике это можно по-разному.

Абсолютное большинство старых и новых игр имеют поддержку многоканального звука вплоть до 7.1 и этой информации вполне достаточно, чтобы сформировать объемный звук в наушниках при помощи таких технологий как DTS Headphone:X и Dolby Headphone.

Эти технологии включены в современные платные пакеты Dolby Access и DTS Sound Unbound для Windows 10 и XBOX, но Dolby Headphone можно было встретить и раньше во встроенных и внешних звуковых картах от ASUS с программным пакетом Dolby Home Theater.

ASUS Xonar U1 — одна из карт с поддержкой Dolby Home Theater. U1 и ее копия U3 в другом корпусе давно исчезла из продажи, но я успел купить ее в далеком 2011 году за 57 долларов по тогдашнему курсу, и о покупке я не пожалел ни разу.

С консолями позапрошлого поколения дела обстояли сложнее: нужен был внешний звуковой процессор с поддержкой Dolby Headphone, и таких на американском рынке было представлено аж два: Astro Mixamp и TurtleBeach DSS.

Последний обошелся мне в 30 с лишним долларов с Ebay. Пользуюсь им и по сей день: и в Playstation 4 Pro поиграть, и фильмы посмотреть с многоканальным звуком. Главное, чтобы консоль, телевизор или медиаплеер умели в сквозную передачу звука в формате Dolby Digital по оптическому интерфейсу S/PDIF.

Как настроить 3D-звук бесплатно (Equalizer APO с плагином HeSuVi)

Но что, если вы не хотите тратить деньги на платный софт или девайсы? Выход есть: использовать бесплатный Windows Sonic, установить старую бесплатную версию Razer Surround или воспользоваться программами Equalizer APO с плагином HeSuVi.

Наилучшее качество, на мой взгляд, дает последний вариант, но придется повозиться. HeSuVi — это фильтр для Equalizer APO, виртуальной звуковой карты с поддержкой множества виртуальных аудио-каналов, фильтров, VST-плагинов и многого другого.

Качаем и устанавливаем Equalizer APO (ссылка внизу), при установке выбираем одно устройство, к которому будут подключены ваши наушники.

Если у вас встроенная звуковая карта, то наушники следует подключать только к главному зеленому стерео-выходу на материнской плате (Динамики High Definition Audio или Realtek USB Audio), зачастую только этот выход позволяет настроить конфигурацию 7.1, на стерео-выходе наушников на передней панели корпуса или монитора звучать все будет неправильно.

Далее перезагружаемся. После качаем и устанавливаем HeSuVi, после запуска установки программа предложит распаковать набор HRIR (импульсы передаточной функции головы) и сразу после этого мы можем проверить работу программы, нажав на кнопку 7.1 Test, заодно проверяем, активна ли конфигурация 7.1 в Windows.

В окне программы HeSuVi в панели Common HRIRs вы можете выбрать режим виртуализации по своему вкусу. Лично мне больше всего нравится режим CMSS-3D, который был записан с легендарной звуковой карты X-Fi Titanium от Creative.

Все готово, можно наслаждаться бесплатной виртуализацией. Также есть возможность поиграться с расстановкой, громкостью и эквализацией каналов в виртуальном пространстве если вам захочется большего.

Главное — не забудьте проверить настройки игр и видеоплееров, чтобы везде был установлен режим 7.1, для тех же, кто хочет использовать лицензионный Atmos, убедитесь, что игра его поддерживает и имеет отдельный режим.

Признаюсь, информации вышло много, и это без путешествий в прошлое, когда балом правила Creative и Aureal, но вывод напрашивается следующий: корпорации все еще не могут продать пространственный звук, чтобы он был единым стандартом с простой настройкой.

А так имеем несколько платных и бесплатных вариантов, которые не совместимы между собой. Добавим сюда фейковый surround смартфонов, ноутбуков, телевизоров и саундбаров — и у самого увлеченного энтузиаста могут опуститься руки, даже если ему повезло с ушами и кошельком.

Надеюсь, что вам повезло с ушами, кошельками и руками, и что вам эта информация оказалась полезной.

Примеры бинаурального аудио:

- Virtual Barber Shop: https://www.youtube.com/watch?v=IUDTl…

- Слушайте Нью-Йорк в 3D-аудио: https://www.youtube.com/watch?v=Yd5i7… –

- Список игр с поддержкой бинаурального аудио: https://docs.google.com/document/d/1u…

- Игры с поддержкой многоканального звука: https://satsun.org/audio/

- HeSuVi: https://sourceforge.net/projects/hesuvi/

- Эквалайзер APO: https://sourceforge.net/projects/equa…

Источник: uspei.com